谷歌眼镜是如何探测人们的情绪的?

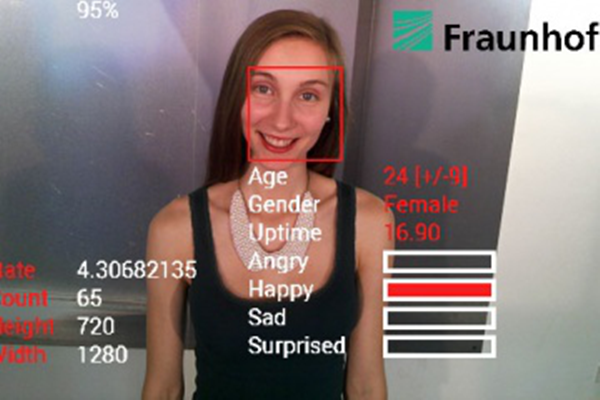

谷歌眼镜使用的面部识别系统SHORE,其设计初衷是为了解释各种各样的视觉暗示。图:FRAUNHOFER IIS/JENS GARBAS

我们人类擅长用谎言、误导和错误的信息来掩盖真实的意图。但在人际交往中最具有说服力的不是说出的话,而是肢体语言。有研究人员表示,我们有一半以上的交流是通过肢体语言呈现出来的,声调和口吻则居于第二第三。

到了科技时代,阅读肢体语言的不再只是人类的眼睛。机器也正试图从那些非语言的线索中,寻找、分辨并解读我们的情绪。

人类情感探测器SHORE是德国弗劳恩霍夫生产技术研究所开发的识别类APP,用于谷歌眼镜上。它的全名是Sophisticated High-Speed Object Recognition Engine,即精密高速目标识别引擎。

对于电脑来说,你的脸只是一个物体,尽管它有着各种独特的轮廓和不断变换的五官形态。在进行识别计算时,SHORE只需要一台简单的数码相机,比如谷歌眼镜的摄像头。然后以每秒10帧左右的速度对相机拍摄传入的图像数据进行分析,并将其与系统使用的校准软件中存有10000张面孔的数据库进行比较。

通过这些对比分析,以及对你脸蛋儿的动态监测,SHORE能以不错的正确率猜出你是高兴、悲伤、惊讶还是生气。SHORE还能以大约94%的正确率“看”出你是男是女,以及你的年龄。

谷歌眼镜会显示连续的视觉更新,你可以看到SHORE提供的实时分析和数据。如果你想,SHORE还可以将你们交谈过程中的音频也用作分析的参考数据。但最终对于他人的看法仍取决于你自己。对方可能是真的喜欢你,也可能只是对你的谷歌眼镜感兴趣。

与轻松的日常用途不同,弗劳恩霍夫研究所的开发人员希望SHORE能够帮助到自闭症或亚斯伯格症候群的患者们。该类病症的患者常常很难读懂他人的情感暗示,或是从当下场合的气氛中搜集信息。但SHORE的实时反馈则能帮助他们更好地理解人与人之间的交流。

汽车制造商还可以将SHORE应用于检测司机的困倦程度。一旦出现司机眼皮耷拉等危险因素,便会触发警报。

医务人员可以使用SHORE更好地识别患者是否出现身体疼痛。它甚至可以通过细微表情的识别帮助检测出抑郁症等心理困扰。在辅助生活的应用中,SHORE可以对病人进行持续的观察以确保他们的安全。

当然,SHORE也能用来赚钱。各类营销公司都可以利用这款应用来判断消费者观看广告、电影预告时的反应,从而更好地了解到广告的宣传效果如何。

不局限于谷歌眼镜,电脑、手机也能使用SHORE。图:STEPHEN LAM/GETTY IMAGES

SHORE的所有计算都从面部检测开始。大约91.5%的情况下,SHORE能正确地检测到人脸。它能识别出你的脸是向前的、偏转的还是面向侧面的。它还可以追踪你的眼睛、鼻子、嘴唇和其它面部特征的运动,并将其和数据库中的每个面部表情进行对比分析。而当你的交流对象距离你6英尺(2米)以内,并正面朝向你的时候,SHORE的识别效果是最好的。

该软件使用了可靠有效的算法来推断每个目标的情绪状态。它的运行速度很快,甚至可以识别出一闪而过的微表情,“背叛”那些善于控制肢体语言的人,告诉你对方的真实情绪。

但SHORE最擅长还是阅读明显的情感。例如露出牙齿的笑容、微笑的眼睛,那代表真正的快乐;而睁大眼睛、张大嘴巴的反应则表示震惊。SHORE能够理解这些线索,但当涉及到悲伤、愤怒等其它情绪时,它就不那么准确了。

如果一个软件能够准确地检测出你的情绪、年龄和性别,那它能识别出你的名字吗?答案是有可能的,但那需要联网。

而SHORE不需要联网就可以执行目标识别检测的功能,只需谷歌眼镜上自带的微型CPU即可。这在很大程度上缓解了人们对于个人隐私泄露的担忧。

如今,与SHORE同类型的识别检测程序仍面临着诸多挑战,例如光线不足、CPU的处理速度、设备的电池寿命等类似的限制。

但正如语音识别的不断改善,我们希望在接下来的情感计算时代中,我们的机器能够帮助处理人性的弱点,并给予我们更多的关心和关怀。

- 关于新冠病毒你要知道的30件事 2022-12-13

- 新冠病毒感染者居家治疗指南 2022-12-12

- 全天候多场景防疫攻略 2022-12-12

- 哪些人退烧不能用布洛芬? 2022-12-12

- 一图读懂《粮食节约行动方案》 2021-11-02

- 《新冠肺炎疫情防护指导手册》 2021-09-19

- 女性不宜喝茶的六个特殊时期 2021-03-08

- 女性经期卫生与保健 2021-03-08

- 麻烦制造者(五)病毒的跨种属传播是啥意思? 2021-02-20

- 麻烦制造者(四)病毒为啥想变异? 2021-02-20

豫公网安备 41070202000552号